Mit tehetünk ma a mesterséges intelligencia mai és holnapi veszélyei ellen?

A mesterséges intelligencia (MI) már utat talált magának a legkülönbözőbb diszciplínák szakmai és üzleti fórumaihoz. Jelenleg nagy érdeklődés mellett folyik azoknak az alkalmazási területeknek a keresése, ahol elfogadható kockázat mellett elegendően nagy hozadék várható tőle: cikksorozatunkban az ehhez kapcsolódó kérdéseket és megoldásokat járjuk körbe.

Soha nem látott vagy soha nem kezelhető veszélyek?

Az MI-re vonatkozó jó hasznosítási ötletek közül sokat elkezdtek már megvalósítani, és a fennmaradók túlnyomó része sem az elérhető eredménybe vetett bizalom hiánya miatt szenved késedelmet, hanem azért, mert a veszélyei még beláthatatlannak és elháríthatatlannak tűnnek.

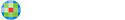

Ma tehát a legtöbb, amit a MI hasznosítása érdekében tehetünk, nem a feladatokhoz és a képességekhez kapcsolódik, hanem azok kordában tartásához. Ha nem tudjuk bebizonyítani magunknak és környezetünknek, hogy felléphetünk a különféle káros következmények ellen, amelyek akár a Terminátor-szerű jövőképekig is terjedhetnek, akkor nagyon mély lesz a jelenlegi felfutást (hype-ot) követő völgy. A mesterséges intelligencia hetvenéves története azt mutatja, hogy a sikeres alkalmazásokba vetett hit hatalmas kilengéseken keresztül növekszik. Az ún. Gartner-ciklus vitatott, ámde rendkívül szemléletes és jelentős magyarázó erővel rendelkező megközelítése szerint ugyanis a technológiai lehetőségek által generált lelkesedést mély kiábrándulás követi, majd a tényleges alkalmazások egy magasabb, de az eredeti várakozásokat alulmúló szinten valósulnak meg.

Ezért félő, hogy a káros következményekkel szembeni tehetetlenség érzése egy újabb indokolatlan kihűlést (közkeletű fordulattal “MI-telet”) hozhat, ahelyett, hogy a megoldás keresésére sarkallna. Ha egy általános figyelem- és erőforrásvesztéssel jellemezhető “téli” időszakban egyes illegális vagy morálisan megkérdőjelezhető alkalmazások mögött viszont fennmaradnának az erőforrások és az eltökéltség, az hosszútávú negatív hatásokkal járhat. Emiatt is fontos feladat, hogy a veszélyek elhárításának már rendelkezésre álló vagy megteremthető feltételeit összegyűjtsük és rendszerbe foglaljuk.

A megoldás kezd kirajzolódni. A MI hasznos keretek között tartására sokféle hozzávalónk van, még ha ezeket nem is tudjuk egyelőre konyhakész módon előállítani egy-egy projekthez. Sok munka, próbálkozás, pilot projekt kell még ahhoz, hogy a korlátok rendszere összeálljon, de fontos már most látni, hogy lesz miből felépíteni a menüt. Ez a jövőkép talán megmutatja a szükséges szakmai képességeket birtokló társterületeknek, hogy érdemes a szellemi erőforrásaikat a mesterséges intelligencia művelésére és az indokolt korlátok kialakítására rááldozni.

A feladat interdiszciplináris. Akkor lehet elvárni a jó szabályozást azoktól, akiknek ez a feladata – egyaránt ideértve a jogszabályok, az intézményrendszer és szervezeteken belüli szabályzatok megalkotóit –, ha látják a technikai lehetőségeket és lehetetlenségeket. Másik oldalról is igaz: a funkciók letéteményesei, vagyis a fejlesztők és mérnökök számára szintén fontos a szabályozási koncepciók ismerete, hiszen ők tudnak majd olyan technikai korlátokat beépíteni az MI-be, amelyek nélkül a szabályozás értelmetlen, pusztába kiáltott szó maradna. Csak olyan szabályokat érdemes létrehozni, amelyek betartására vagy betartatására van kilátás, ennek pedig a termék vagy eszköz kontrollálhatóságában kell gyökereznie.

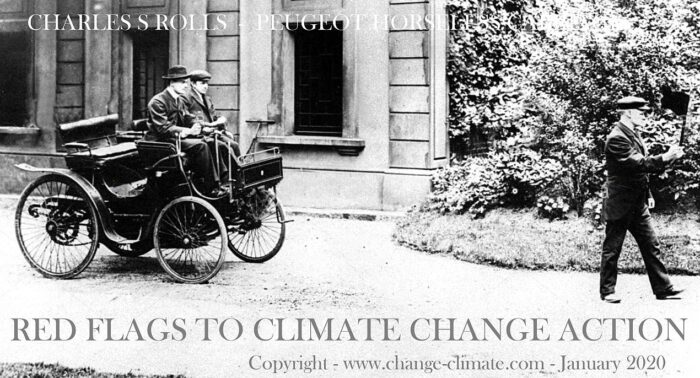

A MI is azon az úton halad, hogy horizontálisan, a gazdasági és társadalmi életet átható általános célú technológiává váljon: nem az MI azonban az első ilyen „general purpose technology”, közkeletű rövidítéssel GPT. A tűz megszelídítése óta számos olyan technológia szolgálja az emberiséget, amelynek kockázatai akár végzetesek is lehetnek alkalmazói számára. A gépjármű-közlekedés hajnalán a kockázatok kordában tartása érdekében hozott ún. Red Flag Law, azaz vörös zászlós törvény (Locomotives Act of 1865) alapján az 1865-től a brit utakon a locomobilokat három fős személyzetnek kellett üzemeltetnie. (Az érdeklődők figyelmébe ajánljuk John Scott-Montagu 1904-ben megjelent, és ma is friss hangvételű tanulmányát, amely az automobilizmus korai tapasztalatainak és jogi szabályozásának nemzetközi összefoglalását adja.) A vezető és az üzemeltető mellett a személyzet harmadik nélkülözhetetlen szereplője az ún. zászlós ember volt, akinek lakott területen 20 yarddal a jármű előtt kellett haladnia, és figyelmeztetnie kellett egyrészt a többi közlekedőt a közeledő locomobilra, másrészt a locomobil vezetőjét, akinek a jelzés esetén azonnal meg kellett állnia. Ekkor vezették be az első sebességlimitet, ami országúton 4 mérföld (6 km) /óra, városban pedig 2 mérföld (3 km) /óra volt.

Mára vetítve a helyzetet, már látjuk, hogy nem lenne például bölcs megoldás az autópályákon általánosan 40 km/h-ra korlátozni a sebességet, hiszen a mérnökök már régen megoldották, hogy ennél sokkal nagyobb sebességtartományok is biztonságosak legyenek, és egy ilyen autópálya értéke annyira csökkenne, hogy nem is lehetne autópályának nevezni. Ugyanakkor lakóövezetben akár a 40 km/h is túl megengedő lehet, hiszen ott nem alkalmazhatók azok a technikai megoldások, amelyek miatt az autópályán ennek többszöröse is elfogadható.

A mesterséges intelligencia projektekben sincs ez másként, de ott még nincsenek bejáratva olyan standard biztonsági intézkedések, mint a szalagkorlát építése vagy a sebességkorlátozás. Az analógiát a jogalkotón túl a jogalkalmazóra is ki lehet terjeszteni: hiába 130 km/h a sebességkorlát egy autópályán, az az autóvezető felelőssége, hogy felismerje, ha az adott körülmények között ennél kisebb sebesség lehet csak biztonságos. A kiválasztott sebesség tartásához pedig megfelelő fékek kellenek, amelyek megalkotása az autó tervezőjének és gyártójának a feladata. A MI-re lefordítva az analógiát, a fejlesztők feladata az ilyen “fékek”, biztonsági eszközök létrehozása és a felhasználó rendelkezésére bocsátása.

Az autópálya biztonságához is sok szereplő egy irányba mutató együttműködése kell. Az útépítőknek, az infrastruktúra fenntartóinak, valamint az autógyáraknak a minőségi munkáján túl szükséges a hatékony ellenőrzés és a szankciók következetes alkalmazása is, mert ezzel lehet biztosítani, hogy az egyes szereplők tevékenysége a közös célt, a kockázatok kezelését szolgálja. Magyarul, ha bármelyik szereplő nem teszi meg azt, amit a biztonságos közlekedésért adott helyzetben meg kell tennie, akkor rosszul kell járnia. Az egyes szakmai területek közös munkájával az MI-ben is megtalálhatjuk azokat a helyzeteket, amikor a szabályozónak 130 km/h helyett 40 km/h sebességet kell előírnia (vagy fordítva), és amikor a sofőrnek ezt sem szabad kihasználnia. Fontos azonban látnunk, hogy a közlekedésben sem ment egyik napról a másikra ennek a konszenzusnak a kialakítása. Ott is sok évtizednyi próbálkozás és útkeresés után jutottunk el a megegyezésig a lakott terület és az országút sebességhatáráról. Azt, hogy a biztonsági öv inkább véd, mint gyilkol, meglepően hosszú diskurzus eredményeként mondhattuk ki. Nem lehetünk annyira optimisták, hogy a mesterséges intelligencia alkalmazása során megtakaríthatjuk ezeket a diskurzusokat: nem várhatunk kész kinyilatkoztatásokat egyik szereplőtől sem.

Remélhető, hogy a KRESZ-hez hasonló általánosan bevett kockázatkezelési rendszer a MI-ben is ki fog alakulni. Az autóközlekedés párhuzama is mutatja, hogy a szereplők széles köre szükséges a kockázatokkal járó, de előzetesen elképzelhetetlen hatékonyságot biztosító technológiák biztonságos üzemeltetéséhez. Az autóközlekedés párhuzama azért is tekinthető indokoltnak az MI esetében, hiszen a szabályok globális koordinációjára van szükség.

Sorozatunk következő részében azt vizsgáljuk, hogy az egyes szervezetek mit tehetnek annak érdekében, hogy saját mikrokozmoszaikban a kockázatkezelő intézkedések fokozatosan ún. irányítási (angol szakirodalomban governance) keretrendszerré álljanak össze úgy, hogy azok már ma is tekintettel legyenek a MI-t alkalmazó projektekre.

A cikk szerzői:

Varga Gábor – mesterséges intelligencia szakértő

dr. Firniksz Judit - kutató, Pázmány Péter Katolikus Egyetem, Versenyjogi Kutató Központ